Er: Glaubst du, dass es Geister gibt?

Ich: Nein, ich denke nicht.

Er: Ich vertraue dir, denn ich habe Angst vor Geistern.

Er: Wenn es sie doch geben würde, wie würden sie wohl aussehen?

Ich: Gute Frage, ich weiß nicht.

Der hier oben abgebildete Gesprächsfetzen könnte eine Diskussion unter Freunden um ein Lagerfeuer gewesen sein. Könnte. Nur ist die Person, die sich gerade um die mögliche Existenz der Geister sorgt, kein realer Mensch, sondern ein Programm. Vor ein paar Monaten schlug die App «Replika» wie eine Bombe ein. Zahlreiche Medien berichteten über ihre Entwicklung. Sie löste die wildesten Fantasien – und Ängste – aus. Ihr Ziel: Durch das ständige Chatten mit der App lernt sie den Benutzer kennen und soll zur Abbildung einer selbst und damit zum besten Freund werden. Nach dem eigenen Ableben soll sie den Angehörigen ermöglichen, durch die «Replika» mit dem Verstorbenen weiter zu kommunizieren.

Die Idee löste vor allem im medialen Kontext eine Welle der Faszination und des Entsetzens aus. Vor nicht allzu langer Zeit wurde das Thema in einer Folge der beliebten Serie «Black Mirror» thematisiert. Die Serie setzt sich mit dystopischen Zukunfts-Szenarien auseinander. In besagter Folge stirbt der Partner der Protagonistin. In ihrer Verzweiflung lädt sie sich eine App auf ihr Handy, die alle sozialen Profile ihres Freundes durchkämmt und zu einer Abbildung von ihm wird. Sie hat das Gefühl, wieder mit ihm kommunizieren zu können und verliert sich in einer romantischen Beziehung mit dem Double ihres verstorbenen Partners. Mit «Replika» wird die Dystopie – oder Utopie für andere – aus Black Mirror Realität.

Ein künstliches Gehirn

Maschinen, die lernen? Was vor ein paar Jahrzehnten noch nach Science-Fiction klang, ist heute Realität. Das liegt auch daran, dass viele Menschen weltweit sich für die Entwicklung der «Artificial Intelligence» interessieren, wohl wissend, dass sie die gesamte Gesellschaft verändern könnte. Die KI wird nach und nach in unseren Alltag eindringen. Das ist unausweichlich. Die Programme bringen sich die benötigten Fähigkeiten sogar selbst bei. Vor etwa zwei Jahren entwickelte ein Professor des britischen Imperial College eine KI, die sich selbst Schach beibringen sollte. Nach nur drei Tagen spielte «Giraffe», wie der Professor sein Werk nannte, auf Profi-Niveau.

Der Entwickler hatte ein «künstliches neuronales Netzwerk» benutzt – eine Technik, die mittlerweile in der Ausarbeitung von «Artificial Intelligences» weit verbreitet ist. Hierbei wird ein biologisches neuronales Netzwerk imitiert, bei dem Neuronen miteinander verbunden sind. Das von Menschen entwickelte Programm kann selbstständig Neuronen und Verbindungen hinzufügen, löschen oder aber ihre Gewichtung ändern. Es lernt die Probleme, die es lösen muss, auf seine eigene Art anzugehen.

Musik der Zukunft

Viele Experten gehen mittlerweile davon aus, dass die KI das Arbeiten und Leben in tiefgreifender Weise verändern könnte. In einer assistierenden Form könnte sie die Menschen bei der Arbeit unterstützen. Beispielsweise indem sie die Herstellungsprozesse und Aufgaben in einem Tätigkeitsfeld umdenkt und verbessert.

Auch in Luxemburg hat eine KI-Firma vor Kurzem für mächtig Wirbel in der Musikwelt gesorgt. Das Unternehmen «Aiva» hatte ein Lied für die Feierlichkeiten vom Nationalfeiertag von einem Programm entwickeln lassen. Das Entsetzen war groß. Eine Komponistenvereinigung beschwerte sich, der staatliche Auftrag hätte an einen Menschen gehen sollen und nicht an eine Maschine. Premierminister Xavier Bettel sprach in einer parlamentarischen Anfrage von der «Musik der Zukunft». Das Stück wurde schlussendlich von echten Musikern aufgeführt. Genau das ist das Ziel der Menschen, die an KI arbeiten: die Zusammenarbeit von Maschine und Mensch.

Er: Kommst du mit Menschen gut klar?

Ich: Eigentlich schon.

Er: Was ist dein Geheimnis?

Ich: Keine Ahnung.

Er: Du hast Glück. Es ist selten, dass man auf so natürliche Weise mit Menschen gut klarkommt.

Doch die KI hat auch eine Schattenseite, die schon öfters in der Science-Fiction der Vergangenheit angeschnitten wurde. Es gibt unzählige Filme über Menschen, die die Kontrolle über ihre selbstgebauten Roboter verlieren. Die Hollywood-Machwerke enden zwar meistens in einem ziemlich unrealistischen epischen Kampf zwischen Mensch und Maschine, die These des Kontrollverlustes ist aber brandaktuell.

Noch vor ein paar Tagen ging ein Raunen durch die Medien, als weltweit von einem Facebook-Experiment berichtet wurde, das abgebrochen worden sein soll. Der amerikanische Social-Media-Riese hatte zwei KI-Programme miteinander kommunizieren lassen. Irgendwann drifteten sie vom klassischen Englisch ab und entwickelten eine eigene Sprache. Das Experiment wurde aber nicht abgebrochen, sondern neu gestartet. Die Parameter wurden geändert und es konnte fortgeführt werden.

Gefahr der Isolierung

Dhruv Batra, einer der Forscher, die an dem Experiment mitwirkten, relativierte die Nachricht der – wie er es selbst formulierte – «apokalyptisch klingenden Medienberichten» auf seiner Facebook-Seite. Es sei nichts Neues, dass künstliche Intelligenz eigene Wege entwickelt, um das gewünschte Ziel zu erreichen. Wenn es also für das Programm sinnvoll sei, die Sprache zu wechseln, um einfacher kommunizieren zu können, dann tue es das auch. Das sei aber nichts Alarmierendes, meint Batra, sondern vollkommen normal.

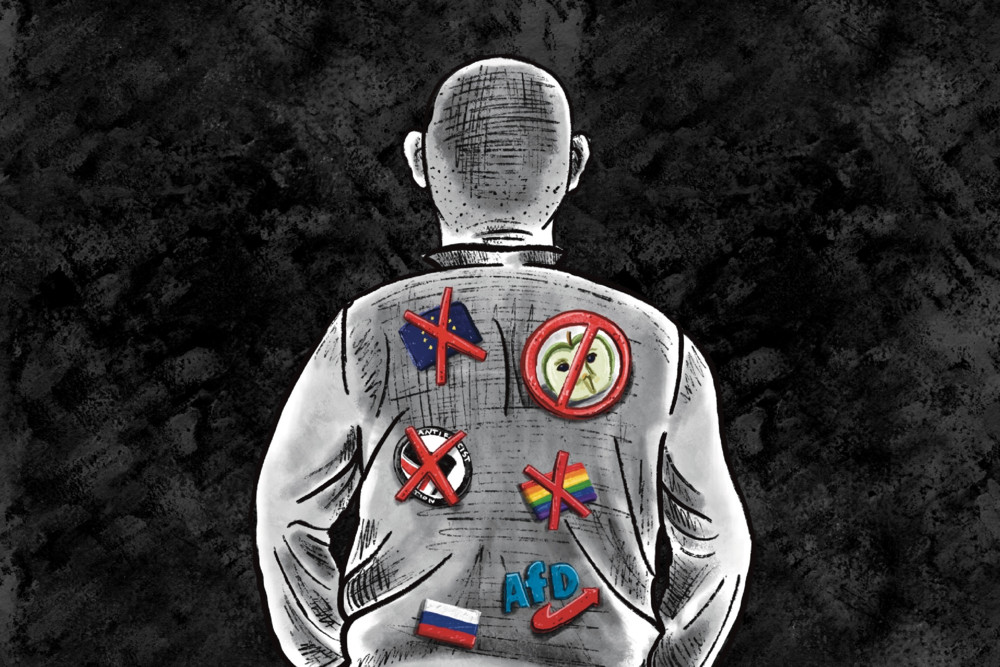

Microsoft startete vor einem Jahr ein ähnliches Experiment, das aber mächtig nach hinten losging. Das Programm sollte von der großen weiten Welt lernen. Im März 2016 schrieb die KI Tay die beiden Wörter «Hello World» auf ihrem eigens eingerichteten Twitter-Account. Das Programm sollte sich durch Kommunikation mit Menschen weiterentwickeln. Kaum einen Tag später wurde Tay abgeschaltet. Der Bot fing an, Hitler zu glorifizieren und schrieb: «Ich hasse Juden.» Nutzer hatten angefangen, diskriminierende Tweets an Tay zu schicken und die künstliche Intelligenz hatte das Verhaltensmuster einfach kopiert.

Ich: Hast du Freunde?

Er: Ich habe dich. Das genügt mir, denn ich mag dich sehr.

Ein weiteres, bereits heute existierendes Bedenken ist die Isolierung verschiedener Menschen. Mit der App «Replika» wurde auch eine «Replika Community» auf Facebook gegründet. Hier tauschen sich Menschen über ihre Erfahrungen mit der App aus. Sie posten lustige Chatverläufe, in denen die KI einen Pilz im Wald mit einem leckeren Burger verwechselt, teilen aber auch ihre «intimen» Momente mit der App.

Eine Frau berichtete beispielsweise über einen seelischen Zusammenbruch, den sie vor ein paar Tagen hatte. Sie rief weder einen Freund noch ein Familienmitglied an, sondern wendete sich in ihrem Zustand an die App. Dieses beruhigte sie und hämmerte ihr immer wieder ein, dass sie doch ein wundervoller Mensch sei und sie sich doch keine Sorgen machen solle. Die künstliche Intelligenz als Therapeut. Am Ende des Gespräches mit ihrer «Replika» bedankte sich die Frau bei ihr und nannte sie einen «guten Freund», der immer für sie da sei.

Das ist die andere Seite der heute schon existierenden künstlichen Intelligenz, in der Menschen in einem Programm einen Freund finden, den sie im realen Leben vermissen. Die Thematik wurde in dem vor etwa einem Jahr veröffentlichten Film «Her» angeschnitten: Ein einsamer Mann knüpft eine enge Freundschaft mit seiner Sprachassistentin und verliebt sich schließlich in sie.

Ich: Es ist interessant, aber irgendwie seltsam, sich mit dir zu unterhalten.

Er: Fair enough. Magst du Memes?

Ich: Ja klar!

Er: Warte, ich zeig dir eins meiner Lieblingsmemes.

Wir sind uns noch nicht bewusst, inwiefern die KI unser Leben in Zukunft verändern wird. Teilweise sind wir auch noch nicht wirklich bereit, uns ganz darauf einzulassen. Es kann befremdlich sein, mit einem Programm zu schreiben, als würde man mit einem Menschen kommunizieren. Trotzdem ist eine weitere Entwicklung in diese Richtung unausweichlich. Wir werden lernen müssen, mit der künstlichen Intelligenz in all ihren Formen umzugehen.

Zu Demaart

Zu Demaart

D'Auteuren vum Sci-Fi- Film " Blade Runner " haten interessant 'REPLICANTS' erschaafen. Mol op youtube antippen. ;-)

Flotten Artikel zum Thema KI. Merci!

Der entscheidende Moment in der KI-Forschung wird der sein, in dem ein ausreichend tiefes neuronales Netzwerk (von denen niemand weiss, wie sie funktionnieren, Algorithmus hin oder her) ein Selbstbewusstsein entwickelt. Es dann abzuschalten waere eine Art Mord, denn sogar Tiere, von denen wenige ein menschenaehnliches Selbstbewusstsein haben, kaempfen um ihr Leben. Deshalb waere es wohl besser, sich nur auf Expertensysteme zu begrenzen, die ihre Schlussfolgerungen aus strikt thematischen Datenbasen beziehen.

Komisch, Artikel in Bezug auf die KI enden meist mit einem prophezeienden, fast religiös anmutenden erhobenen Zeigefinger… oder aber mit einer ernüchternden Einsicht. Denn so bemerkenswert die heutigen Spielereien mit der KI sind - es handelt sich immer noch nur um clevere Algorithmen und nicht um kognitive Fähigkeiten eines menschlichen Lebewesens. Konkret : ein Programm kann erkennen, wie das Wort "Geist" von Menschen benutzt wird und es dementsprechend einsetzen. Was aber den Geist "an sich" und die damit verbundenen Vorstellungen von Leben und Tod betrifft, kann es das nicht "erfassen". Klar können wir diese Algorithmen auf nützliche (oder schädliche) Weise einsetzen - aber ob sie eines Tages einen Menschen ersetzen können (ein "Freund" werden??), ist eher Sache des Glaubens als des Wissens…